曾經我們認為,看到視頻就是看到了真相,如今視頻也不可靠了……

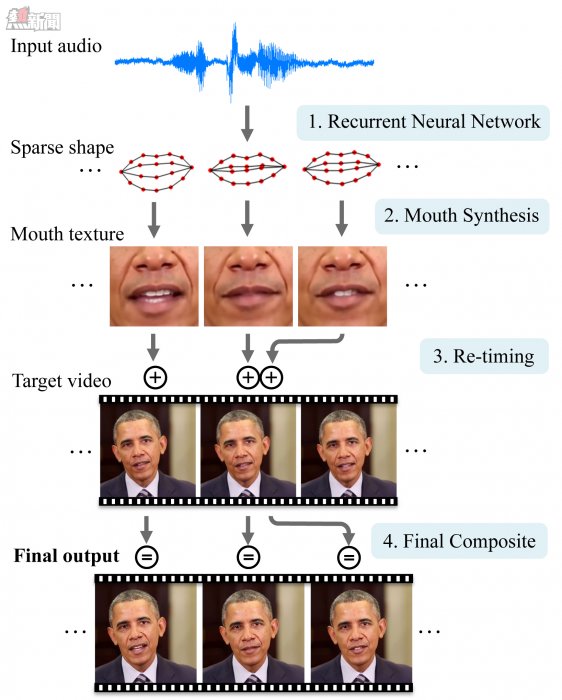

美國華盛頓大學研究團隊用AI「偽造」了奧巴馬的演講視頻,通過深度學習該技術能將聲音轉換為嘴形變化,雖然視頻中的音源確實來自奧巴馬,但說話場景卻完全不同。

經過這樣一個流程「假視頻」就誕生了!

研究者之所以選擇奧巴馬為實驗對象,原因在於網絡上可輕易取得大量奧巴馬公開談話的高畫質影音檔,適合用來訓練人工智能。

難怪川普要一上台就要打擊「假新聞」,原來美國已經擁有這一偽造科技...

該軟件不需要掃描大量的演講影音資料,也不需要分析不同人說出相同句子的嘴形,才能學會轉換聲音;其僅需要既有的影音素材即可,所需成本和規模更小。

從前的奧巴話講話套入現在的影片中

令人擔心的是,這些技術如果遭惡意人士利用,後果不堪設想。例如,可先利用聲音合成技術模仿出某人的聲音,再加上已經訓練好、可將他聲音轉換為嘴形的模型,或是讓聲音相仿的人用「面部重演」技術,即可讓這個人說出從未說過的話。

難怪川普要一上台就要打擊「假新聞」,原來美國已經擁有這一偽造科技...

這麼看來,以後打擊假新聞的難度會越來越大。